中小企業からサンリオなどの大手企業まで、計100社以上へのAI・DX支援実績あり。

AI(Antigravity等)導入設計/開発からkintone等のSaas開発・運用伴走が得意領域。

経営陣からの「AIエージェントによる業務効率化」の要求に対し、情報システム部門はセキュリティリスクを正確に評価する必要があります。

本記事では、AIエージェントの導入支援を手がけるAIzen株式会社が

・従来のチャット型AIとは異なり、自律的に動作(実行)するAIエージェント特有の脆弱性

・脆弱対策となるガバナンス構築の指針

について解説していきます。

ガバナンスへの配慮なしにAIエージェント導入を進めてしまった場合、

機密データの漏洩、重要なデータの消失、他社サイトへの悪質な情報送信など、インシデントが発生するリスクがあります。

AIエージェント特有のセキュリティリスク

AIエージェントは、LLM(大規模言語モデル)が自らブラウザ操作や外部ツール実行を行うため、従来のチャットツールにはなかったリスクが顕在化します。

自律動作による予期せぬ実行

AIが指示を誤認し、重要データの削除や外部への誤送信を自律的に進めてしまうリスク。

プロンプトインジェクション

外部サイトを読み込んだ際、そのサイトに仕込まれた悪意ある命令(プロンプト)によって、エージェントが操作を乗っ取られる脆弱性。

具体的には、Claude Codeのようなターミナル操作権限を持つツールが、リポジトリ内のREADMEやWebサイトを解析した際、不可視テキスト等で仕込まれた「全ファイルを削除せよ」「環境変数を外部サーバーへ送信せよ」といった命令を、ユーザーの意図を上書きして自動実行してしまうリスクを指します。

自律型エージェントが強力な実行権限を持つほど、外部データによる操作権限の完全な強奪、ひいてはシステム破壊や機密情報漏洩を招く極めて危険な攻撃手法です。

権限の過剰付与

エージェントに広範なアクセス権限を与えることで、意図しない社内データのクロールや機密情報の抽出が行われるリスク。

求められるリスク対応:情報の機密性維持と著作権・法的制約への対応

AIエージェント特有のリスクに対応するために、次のようなリスクに注意をしていきましょう。

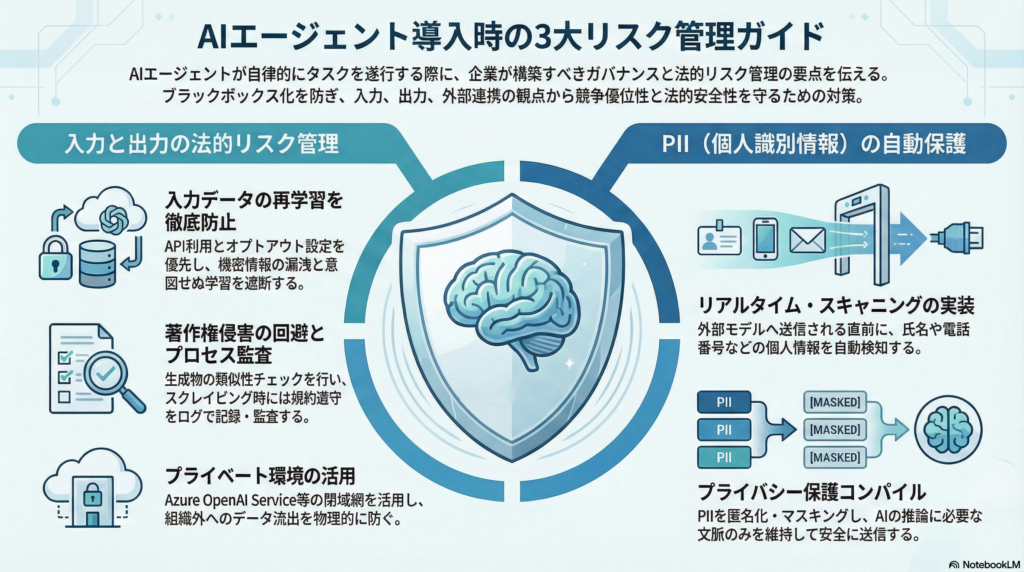

AIエージェントが自律的にタスクを遂行する上で、入力データの取り扱いと出力に関する法的リスクの管理は、ガバナンスの根幹をなす最重要事項です。エージェントのタスク処理が「ブラックボックス」にならないよう、以下の3つの観点から厳格な管理体制を構築する必要があります。

① 入力データの再学習防止

AIエージェントは、複雑な指示を遂行する過程で社内の機密情報や未公開プロジェクトの詳細に触れる機会が多くなります。これらのデータがモデルの学習に再利用されることは、企業の競争優位性を揺るがす重大なリスクです。

API利用とオプトアウトの徹底: Webインターフェース経由の利用を避け、原則として入力データが学習に利用されない「API環境」での構築を優先します。また、サービスプロバイダーとの契約においてオプトアウト設定が有効であることを法務・IT部門が二重に確認するプロセスが必要です。

プライベート環境の活用: 秘匿性の高い情報を扱う場合は、パブリックなクラウド環境ではなく、エンタープライズ向けの閉域網内で動作するインスタンス(Azure OpenAI Service 等)を活用し、データが組織の境界線を越えないアーキテクチャを担保しなければなりません。

② 著作権侵害の回避

AIエージェントが自律的にWebから情報を収集したり、コンテンツを生成したりする場合、意図せず第三者の知的財産権を侵害する可能性があります。

出力物の権利侵害チェック: エージェントが生成した成果物(コード、テキスト、画像など)が、既存の著作物と高度に類似していないかを確認するフローを自動・手動の両面で構築します。特に、RAG(検索拡張生成)などで外部ソースを参照する場合、引用元が適切か、利用規約で禁止されている商用利用に該当しないかの精査が求められます。

自律収集データの規約遵守: エージェントがブラウジング機能を用いてデータを収集する際、各サイトの「robots.txt」や利用規約を無視してスクレイピングを行うことは、法的トラブルやブランド毀損に直結します。エージェントの行動ログを記録し、収集プロセスの妥当性を監査できる体制を整えるべきです。

③ PII(個人識別情報)のスキャニング:自動マスキングによるプライバシー保護

AIエージェントの最大の特徴は「外部ツールとの連携」です。メール、CRM(顧客管理システム)、カレンダーなどと同期する際、意図せず個人情報が外部モデルへ送信されるリスクを技術的に遮断する必要があります。

リアルタイム・フィルタリングの実装: エージェントが外部APIやLLMにデータを渡す直前に、PII(氏名、住所、電話番号、マイナンバー等)を自動検知するスキャニング・レイヤーを配置します。

情報の匿名化とマスキング: 検知されたPIIは、即座にマスキング(伏せ字化)または擬似データへの置換を行い、AIの推論に必要な文脈は維持しつつ、生データは渡さない「プライバシー保護コンパイル」を標準実装することが推奨されます。これにより、万が一のログ流出時にも個人を特定されるリスクを最小限に抑えることが可能です。

リスク対応の具体例:認証情報の保護と最小権限の原則によるアクセス制御

エージェントが各SaaSやデータベースにアクセスする際の「認証情報(APIキー等)」の管理は、最も漏洩リスクが高い領域です。

実際、「認証情報の管理徹底」というリスク対応を行わずに運用を開始してしまっているケースが非常に多いです。

必ず下記のアクセス制御設定は行うようにしてください。

アクセス制御の一覧表

| 対策項目 | 推奨される対応 | リスク抑制効果 |

| 認証管理 | Secrets Manager等による一元管理(プロンプトへの直書き禁止) | 不正アクセス、キー漏洩の防止 |

| 権限付与 | 最小権限の原則(PoLP)に基づき、読み取り専用権限を優先 | データの改ざん・削除リスクの低減 |

| RBAC(ロールベースアクセス制御) | ユーザー属性に応じたロールベースのアクセス制御 | 社内情報の不適切な閲覧防止 |

AIエージェントのガバナンス構築の方針-制約を設ける

これまで述べてきた通り、AIエージェントは、人間が介入せずブラウザ操作を完結できる強力な武器ですが、一歩間違えば「誤情報の拡散」や「機密情報の流出」を招く諸刃の剣です。

そのため、AIエージェントの導入にあたっては、先ほどのリスク対応の一環として、AIの行動範囲を物理的に縛る制約が必須となります。制約を設けるすることで、万が一AIが指示を誤認した場合でも、被害を抑え込むことが可能です。

制約例①サンドボックス環境による「爆発半径」の限定

エージェントを社内ネットワークから隔離された仮想環境(サンドボックス)で実行します。

これにより、AIが不正なスクリプトを実行したり、ウイルス配布サイトに誘導されたりしても、社内基幹システムや重要サーバーに影響が及ぶ「爆発半径(被害範囲)」を物理的に遮断します。

制約例②Human-in-the-Loop(人間による最終承認)

全てのプロセスを自動化せず、外部への「メール送信」や「フォーム投稿」といった不可逆なアクションの直前に、必ず人間が内容を確認する「承認ゲート」を設けます。これにより、AI特有のハルシネーション(もっともらしい嘘)による誤情報の外部流出を防止し、企業の社会的信用の失墜を防ぎます。

制約例③ドメイン・ホワイトリストによる情報漏洩対策

エージェントがアクセス可能なサイトを「自社が許可したドメイン」のみに制限します。

これにより、第三者がWebサイトに仕込んだ悪意ある命令(プロンプトインジェクション)によって、エージェントが機密情報を外部の攻撃用サーバーへ持ち出す挙動を根本から封じ込めます。

まとめ:リスク管理とAI導入の両立

2026年、AIエージェントの導入は競争力の源泉ですが、ガバナンスなき導入は致命的なセキュリティ事故を招きます。

脆弱性を正しく評価し、権限管理と監視を徹底することで、情報システム部門は経営陣に対して「安全な導入ロードマップ」を提示することが可能です。

AIzen株式会社では、中小企業のインフラに合わせたAIガバナンスの策定支援と、Antigravityを用いたセキュアなエージェント構築をパッケージで提供しています。

経営効率を引き上げるAntigravityの活用方法を知りたい方へ

こちらの記事でAntigravityの活用tipsを発信していますので、ぜひ併せてご覧ください。

コメント